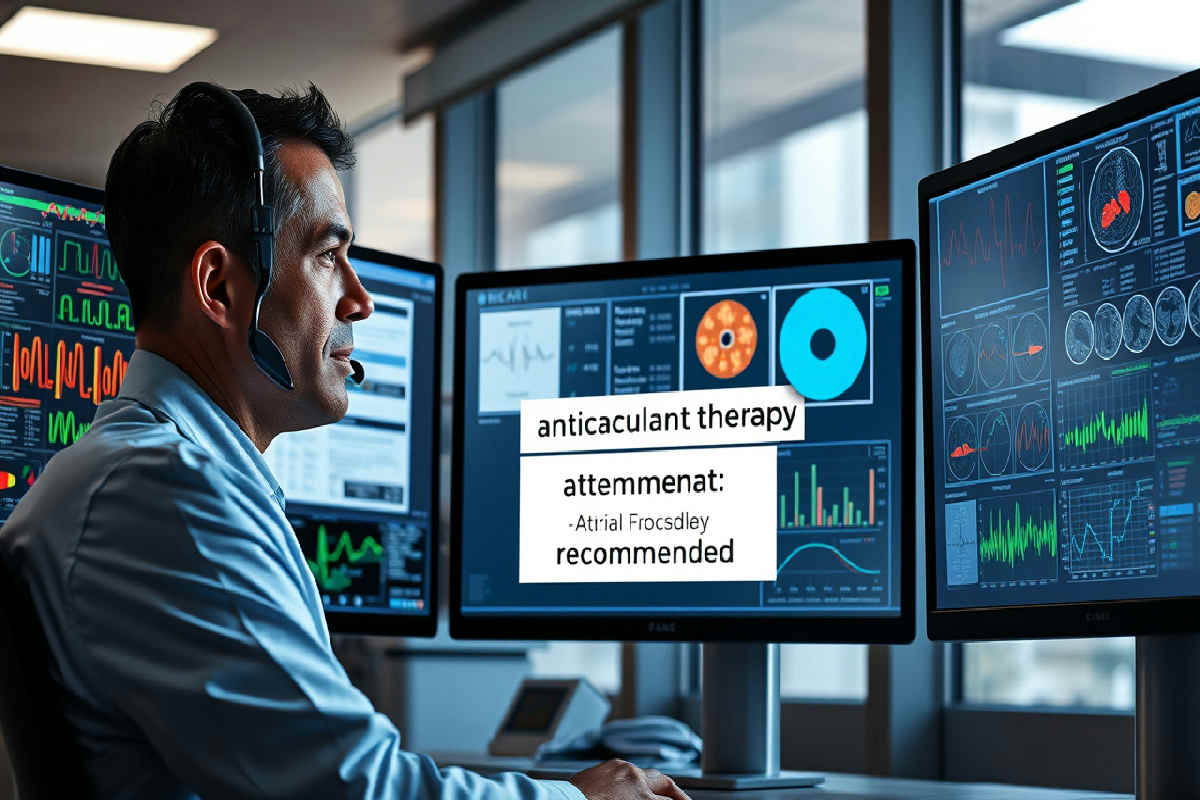

Davanti a uno schermo, un medico scruta cartelle cliniche digitali: esami, immagini, grafici si susseguono. Improvvisamente, appare una raccomandazione chiara: “terapia anticoagulante consigliata” per un paziente con fibrillazione atriale. Non è un ordine, ma pesa. Il medico riflette, sa che la decisione finale è sua, eppure quel suggerimento incide. Seguirlo è semplice, ignorarlo richiede spiegazioni. Questo istante racchiude un cambiamento profondo: la scelta resta umana, ma sempre più spesso si appoggia a un’intelligenza artificiale che traduce dati complessi in consigli clinici.

I sistemi di supporto decisionale entrano nelle corsie degli ospedali

Negli ospedali di oggi, nelle sale d’attesa o nei pronto soccorso, la presenza dei Clinical Decision Support Systems è diventata routine. Questi strumenti analizzano enormi quantità di dati sanitari e aiutano a orientare diagnosi, terapie e priorità. Dal calcolo del rischio al consiglio terapeutico, elaborano modelli predittivi costruiti su milioni di dati. Sono l’evoluzione di quei primi programmi degli anni Settanta, come MYCIN, pensato per diagnosticare infezioni batteriche con regole codificate dagli esperti, o Internist-1, che proponeva diagnosi ordinate per probabilità in base ai sintomi inseriti dal medico.

A differenza di quei sistemi più semplici, le intelligenze artificiali di oggi, soprattutto quelle basate sul deep learning, usano reti neurali capaci di riconoscere schemi che sfuggono all’occhio umano. Così, in ambiti come la diagnosi di tumori cutanei o l’interpretazione delle radiografie, raggiungono risultati pari o superiori a quelli degli specialisti più esperti. Non sostituiscono il medico, ma potenziano la sua osservazione, riorganizzano i dati e suggeriscono opzioni terapeutiche più efficaci e facilmente giustificabili.

Questi programmi non tolgono il ruolo al medico, ma cambiano il modo in cui si arriva alla decisione. Ora è più guidata da una rete di consigli calcolati e meno affidata al solo istinto o giudizio personale.

Medico e tecnologia: una nuova forma di responsabilità

La tecnologia non elimina la responsabilità del medico, ma la trasforma, spesso in modo sottile. Il medico resta l’ultima istanza: firma prescrizioni, autorizza cure. Ma la sua libertà di scelta diventa sbilanciata. Accettare una raccomandazione è semplice, rifiutarla richiede spiegazioni dettagliate e porta con sé rischi morali e legali.

Un caso esemplare arriva dagli Stati Uniti, dove un algoritmo usato per gestire l’assistenza sanitaria ha sottovalutato il bisogno di cure per pazienti di colore rispetto a quelli bianchi. Il problema nasceva dall’uso dei costi sanitari passati come indicatore della gravità clinica. Non era intenzione discriminare, ma la logica statistica ha replicato e amplificato disuguaglianze già esistenti. Questo episodio mostra come l’intelligenza artificiale, inserita in un contesto organizzativo, può ridefinire cosa è “normale” o “giusto” nelle scelte cliniche, influenzando la distribuzione delle risorse e la responsabilità.

Così, la decisione clinica rischia di diventare una semplice ratifica di suggerimenti fatti dalla tecnologia, dove la firma del medico diventa più una formalità che un atto di scelta originale.

Automation bias: quando il medico si affida troppo alla macchina

Il crescente affidamento alle raccomandazioni degli algoritmi porta con sé il fenomeno dell’automation bias: spesso gli operatori sanitari accettano senza sufficiente spirito critico i suggerimenti dell’IA, soprattutto quando sono sotto pressione o hanno poco tempo. Accettare la proposta è meno faticoso e riduce il rischio di errori legali, ma indebolisce il controllo autonomo.

Così il margine d’intervento libero del medico si restringe. La decisione diventa spesso un clic che conferma ciò che indica la macchina. L’errore non è più solo colpa del singolo, ma nasce dall’interazione tra uomo e sistema.

La responsabilità resta, ma si distribuisce su un processo più complesso e meno chiaro. Il medico è sempre garante, ma in uno spazio decisionale dove dire “no” al suggerimento diventa un percorso complicato e rischioso.

Decisioni cliniche tra autonomia, delega e responsabilità in bilico

Nel mondo della medicina la decisione non è mai stata un atto isolato del singolo medico. Si sviluppa dentro reti di protocolli, strumenti e norme condivise. Però con l’intelligenza artificiale questa rete si allarga e cambia. Cresce l’influenza di fattori esterni che definiscono cosa è ragionevole o accettabile.

Formalmente la libertà di scelta resta, ma nella pratica chi decide deve affrontare un peso cognitivo, morale e burocratico maggiore. Scegliere di andare contro l’indicazione della macchina significa isolarsi, giustificarsi e documentare ogni passaggio. Non è più la norma, ma l’eccezione.

Situazioni simili si vedono in altri settori, come aviazione o finanza: gli operatori possono intervenire, ma sanno che la responsabilità e il peso delle conseguenze sono grandi.

Non significa che l’autonomia umana sparisca, ma che cambia forma: diventa più rara e si sposta verso modi più complessi di gestire la responsabilità. La decisione “libera” diventa un’eccezione che va motivata.

Intelligenza artificiale: opportunità e limiti in diagnosi e cura

L’intelligenza artificiale ha portato vantaggi concreti in tanti campi clinici. In oncologia, per esempio, ha migliorato la classificazione dei pazienti e la personalizzazione delle terapie, con effetti positivi sui risultati. Ma insieme sono emerse criticità: bias nei dati usati per addestrare i modelli e performance peggiori su gruppi meno rappresentati, come pazienti con particolari caratteristiche cutanee.

Questi limiti mostrano che l’IA, pur ampliando le possibilità diagnostiche, può anche riprodurre disuguaglianze e introdurre errori sistematici se non viene progettata, testata e monitorata con attenzione.

Oltre agli aspetti tecnici, l’arrivo dell’IA in sanità sposta la responsabilità dal singolo a un contesto tecnologico e culturale più complesso, che richiede non solo competenze cliniche, ma anche etiche e sociali.

Vivere consapevolmente la decisione nell’era digitale

La vera sfida oggi non è più scegliere tra uomo e macchina, ma capire e gestire lo spazio che si apre tra il suggerimento algoritmico e la decisione finale del medico. Il rischio è che la scelta diventi poco più che una firma su decisioni già prese dai sistemi, con una responsabilità meno visibile.

Per mantenere libertà e responsabilità serve consapevolezza, trasparenza, controllo critico e revisione continua.

La tecnologia cambia il modo in cui giudichiamo, decidiamo e ci assumiamo responsabilità in sanità, segnando una svolta importante nella pratica medica. Di fronte a questo cambiamento, è fondamentale tenere alta l’attenzione sugli aspetti etici, sociali e organizzativi, senza mai dimenticare che al centro resta il paziente e la cura personale.